뉴런 네트워크가 다른 기술들과 다르게 훌륭한 점은

매우 수학적으로 잘 정의되어 있기 때문에

명쾌하고 명확하다는 점이다.

물론 이런 기술을 읽기 위해

다소 수학적 지식이 필요하고

뿐만 아니라 이를 이해할 수 있어야만 하지만 말이다.

그렇기 때문에 어쩌면

개발자가 배우기 까다로운 기술일지도 모른다는 생각을 한다.

어쨋든 앞서 순 방향 전파 중 하나를 구현해봤다

이것만으로는 완성된 순방향 전파라고는

하기 힘들다.

이제 활성화 함수 구현에 대한 이야기를 해보자

활성화 함수에 대해

활성화 함수란 계산한 해당 노드를 훈련 데이터로서

사용할 것인지 아닌지에 대한 판단을 해주는 함수이다.

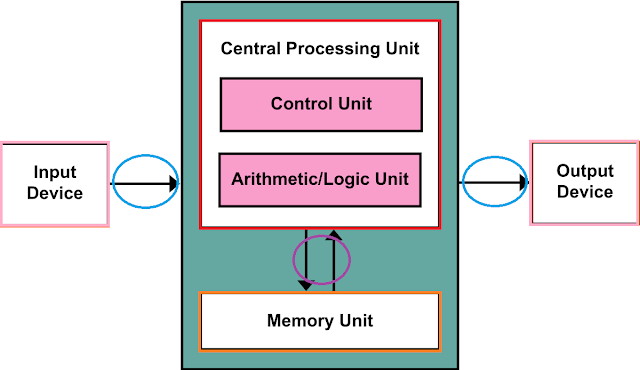

인간으로 비유하자면,

중요한 정보와 덜 중요한 정보를 판단하는 해주는

장치라고 생각하면 편할지도 모른다.

다만, 활성화 함수에 대한 자세한 이야기는

이전에 포스팅했기 때문에 해당 포스트를 참고하기 바란다.

활성화 함수의 구현

서론에서도 이야기 했듯이

뉴런 네트워크는 다른 기술들과 다르게

수학적으로 잘 정의된 기술이기 때문에 코드가 굉장히 짧다.

이를 잘 나타내주는 것이

바로 활성화 함수라고 나는 생각하고 있다.

놀라울 정도로 간단하기 때문이다.

몇 가지 활성화 함수들을 구현해 보자.

① Sigmoid

가장 간단한 시그모이드 부터 구현해보자.

| class Active_Function: def sigmoid(self, inputs): self.sig_output = (1/(1 + np.exp(-inputs))) | cs |

코드는 위와 같으며,

앞서 언급했듯이 뉴런 네트워크는 수학적으로 매우 잘 정의되어진

기술이기 때문에 코드는 매우 간결하다.

② Leakly ReUL

다음은 Leakly ReUL이다.

| class Active_Function: def leakly_ReLU(self, inputs): self.lReLU_output = np.where(inputs>0, inputs, inputs*0.01) | cs |

③ Swish

다음은 Google팀에서 개발했다는 Swish다

| class Active_Function: def swish(self, inputs): sig_output = (1/(1 + np.exp(-inputs))) self.swish_output = inputs * sig_output | cs |

이후 코드가 바뀔 가능성이 높지만

일단 나는 이 세 개의 활성화 함수를

하나의 클래스로 묶고 싶기 때문에 실제 코드는 아래와 같다.

| class Active_Function: def sigmoid(self, inputs): self.sig_output = (1/(1 + np.exp(-inputs))) def leakly_ReLU(self, inputs): self.lReLU_output = np.where(inputs>0, inputs, inputs * 0.01) def swish(self, inputs): sig_output = (1/(1 + np.exp(-inputs))) self.swish_output = inputs * sig_output | cs |

뉴런 네트워크에 추가

그렇다면 위의 구현했던 활성화 함수를

이전에 만들었던 뉴런 네트워크에 추가해

실제로 실행해보자.

뉴런 네트워크에 활성화 함수를 추가한 코드는 아래와 같다.

1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 20 21 22 23 24 25 26 27 28 29 30 31 32 33 34 35 36 37 38 39 40 41 42 43 44 45 46 47 48 49 50 51 52 53 54 | ##blog import numpy as np #랜덤 값 시드 생성 np.random.seed(0) input_data = [3, 1, 5.5] class Layer_Dense: def __init__(self, n_inputs, n_neurons): #randn : 0으로 중심으로한 가우스 분포를 무작위 생성 #실제 randn 함수는 1을 초과한 값을 출력하기 때문에 0.10을 곱함 self.weights = 0.10 * np.random.randn(n_inputs, n_neurons) #뉴런 수만 큼 0값을 가지는 편향 생성 self.biases = np.zeros((1, n_neurons)) def forward(self, inputs): #순방향 전파 수식을 표현 self.output = np.dot(inputs, self.weights) + self.biases class Active_Function: def sigmoid(self, inputs): self.sig_output = (1/(1 + np.exp(-inputs))) def leakly_ReLU(self, inputs): self.lReLU_output = np.where(inputs>0, inputs, inputs * 0.01) def swish(self, inputs): sig_output = (1/(1 + np.exp(-inputs))) self.swish_output = inputs * sig_output hidden_act_obj = Active_Function(); #입력이 3개, 출력 노드가 4개인 레이어 객체 생성 hidden_layer = Layer_Dense(3,4) #입력이 4개, 출력 노드가 2개인 레이어 객체 생성 output_layer = Layer_Dense(4,2) # 입력 레이어를 매개변수로 해 히든 레이어의 노드(순방향 전파)값 계산 hidden_layer.forward(input_data) # 히든 레이어의 순방향 전파 값을 각 활성화 함수에 넣어 활성화 판단 hidden_act_obj.sigmoid(hidden_layer.output) hidden_act_obj.leakly_ReLU(hidden_layer.output) hidden_act_obj.swish(hidden_layer.output) #활성화 판단된 히든 레이어의 값을 매개 변수로 출력 레이어의 노드(순방향 전파)값 계산 output_layer.forward(hidden_act_obj.sig_output) output_layer.forward(hidden_act_obj.lReLU_output) output_layer.forward(hidden_act_obj.swish_output) print(output_layer.output) | cs |

① Sigmoid 실행 결과

② Leakly ReUL 결과

③ Swish 결과

마치며

지금까지 해서 활성화 구현과 실제 뉴런 네트워크의

히든 레이어에 활성화 함수를 사용하는 것 까지 해보았다.

물론 여기서 끝은 아니다.

아직 역전파 처리가 남았다.

그리고 이 순방향과 역전파를 여러번 반복해야만

정말로 의미 있는 뉴런 네트워크를 만들었다고 할 수 있을 것이다.

또한 실제 구현한 코드로 옳은 값을 계산했는지에 대한

검증도 필요하다.

검증은 이번 주제의 글을 마무리 한 후에 할 생각이다.

다음으로는 역전파에 대한 이야기를 해보려고 한다.